为阿凡达续集试水?阿丽塔制作技术深度详解

时间:2019-03-15 15:10

《阿丽塔》对于阿凡达系列来说,确实是一个很不错的技术测试环境。

关于电影《阿丽塔:战斗天使》幕后的制作技术,我们真是看的太多了,相信大家背着都能说出个一二三点吧:“将阿凡达技术升级,把动作捕捉升级为表演捕捉”“800位艺术家、三万台电脑参与特效制作”“4.32亿个小时的渲染时长”“卡神写了600页拍摄笔记”“鬼才导演57天结束拍摄”…不得不说,这部电影技术方面确实比剧情方面更胜一筹。而卡神在接受媒体时透露,这么庞大制作体量只是《阿凡达》续集电影技术的试水过程。Weta Digital视效总监 Eric Saindon也表示,《阿丽塔》对于阿凡达系列来说,确实是一个很不错的技术测试环境。用一部电影试水另一部电影,这操作也是很6了。

目前,《阿凡达2》《阿凡达3》和《阿凡达4》其中一部分的“主要捕捉”拍摄已经结束了,在新西兰实景地拍摄了4个月。和阿丽塔不太一样,新的阿凡达电影只涉及到很少一部分实拍,差不多是几个实拍角色贯穿到大量CG场景中;而阿丽塔是一些CG角色和实拍场景交互到一起。

Saindon还提到,在新的阿凡达电影中人类角色会融入到Na'vi雨林、海洋、山脉等场景,使用3d手法进行拍摄,看起来会很壮观。诶,好像说了很多关于阿凡达的内容,这并不是今天的重点啊。之前的内容我们只是很浅显的介绍一些阿丽塔的特效制作,那么今天的文章会让大家对Weta制作阿丽塔有一个更深层次的认识。我们尽量把复杂的技术内容解释得简单清晰,可以方便萌新小伙伴和专业人士阅读~

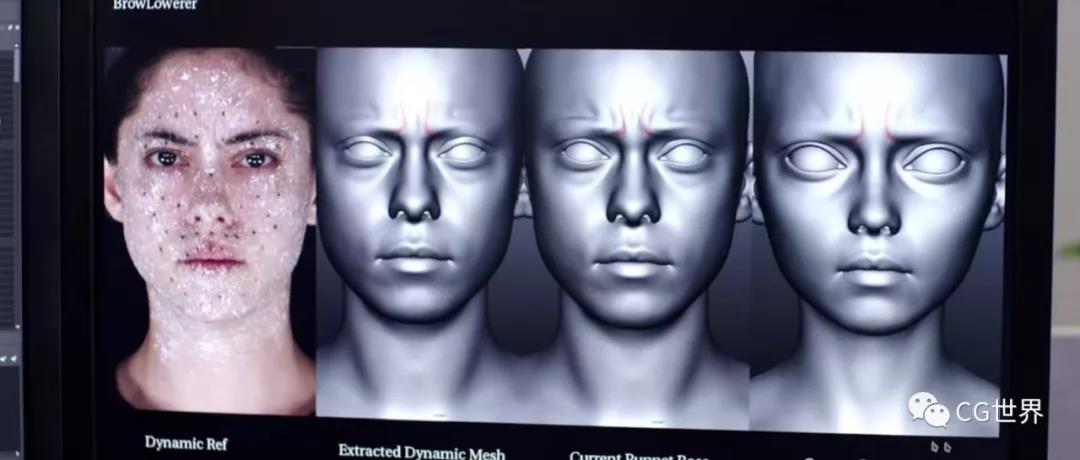

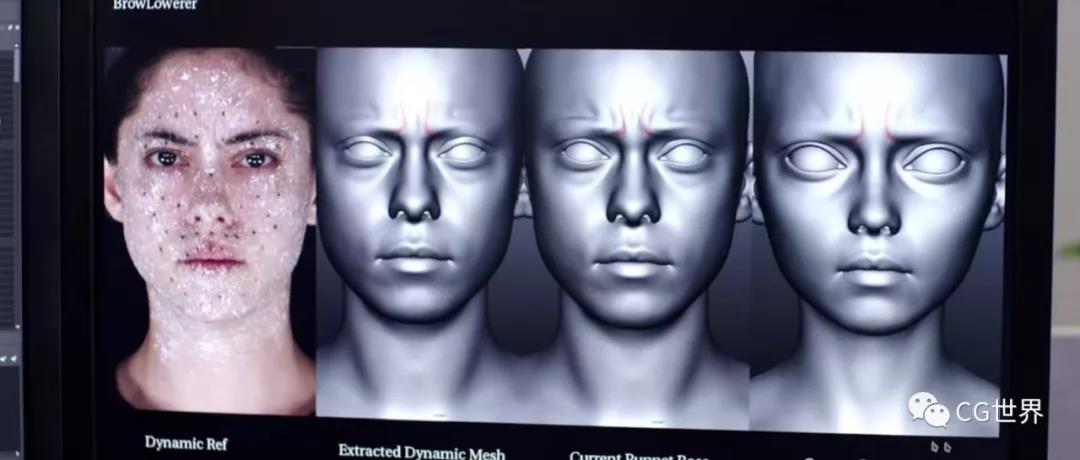

表演捕捉结束之后,他们并没有立刻开始关于阿丽塔的制作。而是将女演员的动捕结果投到了一个和她长得差不多的数字模型身上。团队先是研究这个模型的动作数据,再和实际捕捉数据进行横向比较,观察这样的方式是不是能够准确呈现演员面部肌肉的各种运动细节。直到实现了一比一完全真实还原以后,团队才将这些数据重新定向到阿丽塔模型身上。

Weta是最先将FACS(面部行为编码系统)应用于VFX行业的,现在他们的流程也都是基于这个基础之上的。原来的FACS表情是用0-1的范围来表示的,0就是没有任何面部肌肉张力,1就是极度夸张的表情。而阿丽塔面部表情太丰富了,这就要求每个面部肌肉都要相应地有所反应,因此团队重新定义了FACS。比如想要获取演员类似于嘴角微微上扬这种细微表情的数据,就需要提高面部捕捉的敏感度。此时我们用100%来定义FACS范围的话,那这里的细微变化可能就是0.1%,可能是0.5%,也有可能是0.3%,这样一来,你就明白这个动作是有多么细微了!

除此以外,为了提高面部捕捉敏感度、改建FACS交互方式,团队还进行了大量工作来改进面部绑定和建模,咨询整形外科医生,了解面部细微结缔组织和肌肉是如何分部的。

此外,Weta团队还获取了演员的一系列对话参考,其中包含了讲话时的各种面部表情,有助于完善数字角色和她唇形同步的过程。

说到这里,我们要引入两个专业术语,就是上面那两个。阿丽塔制片人表示,在捕捉过程中,他们特别注意避免发生FDR。没有身体动作配合的第二次面部表情,和之前是肯定是不同的。就算是把面部表情捕捉和第一次身体捕捉相结合,也还是会破坏表演的完整性。头部脸部,以及脖子和肩膀,哪怕有一处不是真实拍摄时发生的,就会产生完全不同的表现。所以团队会尽可能保持同一种情绪的表演捕捉。

然鹅,HMC头戴相机的面部捕捉数据在某些情况下有很大的局限性,为什么这么说呢?有下面这两个原因。

首先是在一些动作序列里,装置本身会给演员表演带来不便。虽然技术团队在尽力避免因装置不平衡而对演员脖子造成的损伤,但它本身的重量还是会影响演员表演的幅度范围;

第二就是剧本中设计到的动作远远超过了演员本人的可操作性,比如对于一些跳跃挨打等极限动作的面部反应,出于安全考虑是不会让演员真实表现的,只能是由动画师来完成一个相对可信的效果。比如机动球游戏序列,她没办法真实表现穿着旱冰鞋环形面跳跃的效果,只能通过肌肉模拟和手部动画来实现那个状态下的面部动态。在演员脸上加入肌肉模拟,实现撞击地面、被机动球砸到和高速运动下的各种效果。

说到面部肌肉模拟,那么就意味着要估计演员脸上独特的带状肌肉,毕竟每个人的脸都是不同的,又没办法好像法医一样,把脸切开看看里面到底是什么样子。在此之前,Weta都是利用一些x光数据来解决类似于这样的问题,但是这回是依靠模型师多年行走江湖的经验,从普通的头骨开始,根据演员个人的实际情况进行调整。这种头骨拟合的方式更适用于艺术行业。

除了头骨之外,他们还利用演员牙印来创建牙齿并精确估计舌头的位置。在Weta,如果想要创建一个精准角色,首先要做的就是模拟舌头,因为它会影响整个动画和灯光效果。角色在讲话的时候,舌头反射的光是非常复杂的,如果无法正确预估舌头的位置,最终渲染出来的就是一个黑洞。

读了上面的内容我们了解到,尽管FACS对于项目制作很有很大的帮助,但想要实现真人和角色的完美匹配,还是需要艺术家们高超且丰富的制作经验和艺术功底。

新的深度学习工具

“深度学习”“机器学习”和AI是目前很多行业都在运用的前沿技术,之前CG世界介绍过很多基于人工智能的软件,Weta也一直致力于这方面的研究。他们所运用的人工智能,不单独指某种解决方案,而是包含了多种工具。比如这次阿丽塔的项目,他们就把面部标记点运用到了深度学习中。他们是如何应用的呢?

团队先是导入演员面部表情的信息(可以称为训练数据),标记点可以通过深度学习的方式,让计算机识别处在不同脸部肌肉的不同标记点是如何运动的。这里并没有把深度学习当作跟踪工具,而是用作了合理的表情空间。比如下面的这个镜头,雨果抚摸阿丽塔的脸,相当于一部分脸被遮挡起来,演员面前也没有那根相机支撑臂,系统还是可以推断或“识别”标记点。与其说是重现表情,倒不如说是实现表情。深度学习将演员面部表情进行分解,激活与之相对应的面部肌肉,驱动面部模型自己产生表情。利用这种方式将会更有助于重建数字角色。

Weta用于生成阿丽塔皮肤的新工具也用到了深度学习,是他们一直在开发的一款用于绘制和识别皮肤区域的新方法,可以真实合理地生成皮肤和毛孔的大小和走向。这种方式避免了把一块面部细节复制到另一块的常规做法,而是利用深度学习技术在面部合适的位置设置毛孔,或者是使皮肤毛孔自然而然地呈现在正确的位置上。虽然在程序模型上基于表面法线利用算法绘制毛孔也能实现,但深度学习是直接获取训练数据,结果更为准确。不仅改进了传统方法,且一种非常巧妙的程序性方式。

Weta之前用过森林生长工具,也用过类似于今天AI编程简单版本的群集代理模拟工具Massive 。但使用深度学习这种很特别的方法还是第一次见。如今,他们在特效模拟和高级植被工具等多种领域都用到了机器学习技术。

提到阿凡达续集,我们最先想到的是Weta会肩负起多个序列的制作任务,却很少有人了解卡神竟然动了潘多拉星球水下世界的主意。卡神非常擅长水下世界的拍摄和探索,从他1989年的作品《深渊》中我们就能发现这一点,那是一段关于太平洋底部马里亚纳海沟最深处的真实体验。

Weta为阿凡达续集开发的新技术,就拿阿丽塔来练手了,也就是在影片中阿丽塔跳进湖中,在水下行走到达那艘坠毁沉船的序列。阿丽塔从水中走出进入船舱的镜头非常完美,而从多种技术角度来看,这种全水下镜头也标志着制作水下动画新技术的诞生。

这部分能有啥技术性?咱们慢慢分析。如果演员是在陆地上进行水下行走表演的动作捕捉,那么肯定没办法解决人在水下会受到浮力的这个事实,因为水下会缓和重力对人的影响。就算是演员在一根钢丝上站立,他四肢的支撑以及晃动的感觉,在平地上也是没办法模拟的;其次是阻力的问题。在水下行走的真实情况中,水的阻力是会很自然地改变身体行走的倾斜方式;还有就是涉及到水下流体动力学的力量,和陆地空气的感觉是截然不同的。综合考虑上面说的这三个问题简单讲就是,人在水下会有这样的情况:因为浮力,脸部受到重力影响的向下幅度会减缓;手在脸边活动,水流压力会影响面部表情;向前行走,水还会给人一个向后的阻力。这些都是在陆地上实现不了的。

面对这些问题,Weta的解决方案是多方面进行组合,将流体模拟、肌肉模拟、头发模拟、布料模拟结合在一起,为角色和相应体积创建出一套复杂而又具有完整功能的方案。使这些元素交互在一起,不必每次只处理一个方面,而是以整体进行解决。从以往的制作经验来说,没有过在同一时间解决所有模拟的情况。一般情况下先模拟皮肤再模拟布料,接着头发和水的传统过程。但这种流程一旦出现问题,只能是一个环节一个环节返回去解决。而新的技术是获取演员在水下的动作,导入到角色的数字骨骼上,在同一时间搞定所有方面。

宣发统筹:聚城视界

目前,《阿凡达2》《阿凡达3》和《阿凡达4》其中一部分的“主要捕捉”拍摄已经结束了,在新西兰实景地拍摄了4个月。和阿丽塔不太一样,新的阿凡达电影只涉及到很少一部分实拍,差不多是几个实拍角色贯穿到大量CG场景中;而阿丽塔是一些CG角色和实拍场景交互到一起。

Saindon还提到,在新的阿凡达电影中人类角色会融入到Na'vi雨林、海洋、山脉等场景,使用3d手法进行拍摄,看起来会很壮观。诶,好像说了很多关于阿凡达的内容,这并不是今天的重点啊。之前的内容我们只是很浅显的介绍一些阿丽塔的特效制作,那么今天的文章会让大家对Weta制作阿丽塔有一个更深层次的认识。我们尽量把复杂的技术内容解释得简单清晰,可以方便萌新小伙伴和专业人士阅读~

Weta Digital面部捕捉流程

我们都知道,阿丽塔是Weta第一次制作的全CG类人角色,眼睛大嘴巴小的特征,突出了角色来源于漫画人物。他们在尝试表演捕捉时采用的新方法之一,就是让一位女演员佩戴头盔相机装置(HMC)以及包括手臂在内的全身动捕装置。配备的两个相机是标准高清款,可以为表演捕捉提供各种客观且可靠数据信息。此外,团队还在她的脸上设置了可用于深度学习工具的标记点,很显然,他们已将几个重要的深度学习工具纳入到面部捕捉流程中。

改进FACS流程

Weta是最先将FACS(面部行为编码系统)应用于VFX行业的,现在他们的流程也都是基于这个基础之上的。原来的FACS表情是用0-1的范围来表示的,0就是没有任何面部肌肉张力,1就是极度夸张的表情。而阿丽塔面部表情太丰富了,这就要求每个面部肌肉都要相应地有所反应,因此团队重新定义了FACS。比如想要获取演员类似于嘴角微微上扬这种细微表情的数据,就需要提高面部捕捉的敏感度。此时我们用100%来定义FACS范围的话,那这里的细微变化可能就是0.1%,可能是0.5%,也有可能是0.3%,这样一来,你就明白这个动作是有多么细微了!

除此以外,为了提高面部捕捉敏感度、改建FACS交互方式,团队还进行了大量工作来改进面部绑定和建模,咨询整形外科医生,了解面部细微结缔组织和肌肉是如何分部的。

相机捕捉系统

在制作过程中,Weta用自己的相机捕捉系统替代了制作逼真人脸模型的特殊技术Light Stage和美杜莎Rig。拍摄棚内有60台相机,全方位覆盖演员周围180°的各个角落,这套相机系统可以捕捉4D数据,对于一些关键情节和序列的表演,团队让演员在这套系统中进行重现,它会为深度学习过程提供参考和其他补充数据。此外,Weta团队还获取了演员的一系列对话参考,其中包含了讲话时的各种面部表情,有助于完善数字角色和她唇形同步的过程。

ADR

(Automated Dialog Replacement)

自动对话重置,根据同期声参考声带进行对白重置的技术

FDR

(Facial Dialog Replacement)

面部对话重置,是ADR的面部版本

(Automated Dialog Replacement)

自动对话重置,根据同期声参考声带进行对白重置的技术

FDR

(Facial Dialog Replacement)

面部对话重置,是ADR的面部版本

说到这里,我们要引入两个专业术语,就是上面那两个。阿丽塔制片人表示,在捕捉过程中,他们特别注意避免发生FDR。没有身体动作配合的第二次面部表情,和之前是肯定是不同的。就算是把面部表情捕捉和第一次身体捕捉相结合,也还是会破坏表演的完整性。头部脸部,以及脖子和肩膀,哪怕有一处不是真实拍摄时发生的,就会产生完全不同的表现。所以团队会尽可能保持同一种情绪的表演捕捉。

Weta动画总监Mike Cozens

然鹅,HMC头戴相机的面部捕捉数据在某些情况下有很大的局限性,为什么这么说呢?有下面这两个原因。

首先是在一些动作序列里,装置本身会给演员表演带来不便。虽然技术团队在尽力避免因装置不平衡而对演员脖子造成的损伤,但它本身的重量还是会影响演员表演的幅度范围;

第二就是剧本中设计到的动作远远超过了演员本人的可操作性,比如对于一些跳跃挨打等极限动作的面部反应,出于安全考虑是不会让演员真实表现的,只能是由动画师来完成一个相对可信的效果。比如机动球游戏序列,她没办法真实表现穿着旱冰鞋环形面跳跃的效果,只能通过肌肉模拟和手部动画来实现那个状态下的面部动态。在演员脸上加入肌肉模拟,实现撞击地面、被机动球砸到和高速运动下的各种效果。

说到面部肌肉模拟,那么就意味着要估计演员脸上独特的带状肌肉,毕竟每个人的脸都是不同的,又没办法好像法医一样,把脸切开看看里面到底是什么样子。在此之前,Weta都是利用一些x光数据来解决类似于这样的问题,但是这回是依靠模型师多年行走江湖的经验,从普通的头骨开始,根据演员个人的实际情况进行调整。这种头骨拟合的方式更适用于艺术行业。

除了头骨之外,他们还利用演员牙印来创建牙齿并精确估计舌头的位置。在Weta,如果想要创建一个精准角色,首先要做的就是模拟舌头,因为它会影响整个动画和灯光效果。角色在讲话的时候,舌头反射的光是非常复杂的,如果无法正确预估舌头的位置,最终渲染出来的就是一个黑洞。

读了上面的内容我们了解到,尽管FACS对于项目制作很有很大的帮助,但想要实现真人和角色的完美匹配,还是需要艺术家们高超且丰富的制作经验和艺术功底。

新的深度学习工具

面部肌肉识别

“深度学习”“机器学习”和AI是目前很多行业都在运用的前沿技术,之前CG世界介绍过很多基于人工智能的软件,Weta也一直致力于这方面的研究。他们所运用的人工智能,不单独指某种解决方案,而是包含了多种工具。比如这次阿丽塔的项目,他们就把面部标记点运用到了深度学习中。他们是如何应用的呢?

团队先是导入演员面部表情的信息(可以称为训练数据),标记点可以通过深度学习的方式,让计算机识别处在不同脸部肌肉的不同标记点是如何运动的。这里并没有把深度学习当作跟踪工具,而是用作了合理的表情空间。比如下面的这个镜头,雨果抚摸阿丽塔的脸,相当于一部分脸被遮挡起来,演员面前也没有那根相机支撑臂,系统还是可以推断或“识别”标记点。与其说是重现表情,倒不如说是实现表情。深度学习将演员面部表情进行分解,激活与之相对应的面部肌肉,驱动面部模型自己产生表情。利用这种方式将会更有助于重建数字角色。

深度学习对皮肤的应用

Weta用于生成阿丽塔皮肤的新工具也用到了深度学习,是他们一直在开发的一款用于绘制和识别皮肤区域的新方法,可以真实合理地生成皮肤和毛孔的大小和走向。这种方式避免了把一块面部细节复制到另一块的常规做法,而是利用深度学习技术在面部合适的位置设置毛孔,或者是使皮肤毛孔自然而然地呈现在正确的位置上。虽然在程序模型上基于表面法线利用算法绘制毛孔也能实现,但深度学习是直接获取训练数据,结果更为准确。不仅改进了传统方法,且一种非常巧妙的程序性方式。

Weta之前用过森林生长工具,也用过类似于今天AI编程简单版本的群集代理模拟工具Massive 。但使用深度学习这种很特别的方法还是第一次见。如今,他们在特效模拟和高级植被工具等多种领域都用到了机器学习技术。

阿丽塔&阿凡达水下皮肤模拟

提到阿凡达续集,我们最先想到的是Weta会肩负起多个序列的制作任务,却很少有人了解卡神竟然动了潘多拉星球水下世界的主意。卡神非常擅长水下世界的拍摄和探索,从他1989年的作品《深渊》中我们就能发现这一点,那是一段关于太平洋底部马里亚纳海沟最深处的真实体验。

Weta为阿凡达续集开发的新技术,就拿阿丽塔来练手了,也就是在影片中阿丽塔跳进湖中,在水下行走到达那艘坠毁沉船的序列。阿丽塔从水中走出进入船舱的镜头非常完美,而从多种技术角度来看,这种全水下镜头也标志着制作水下动画新技术的诞生。

这部分能有啥技术性?咱们慢慢分析。如果演员是在陆地上进行水下行走表演的动作捕捉,那么肯定没办法解决人在水下会受到浮力的这个事实,因为水下会缓和重力对人的影响。就算是演员在一根钢丝上站立,他四肢的支撑以及晃动的感觉,在平地上也是没办法模拟的;其次是阻力的问题。在水下行走的真实情况中,水的阻力是会很自然地改变身体行走的倾斜方式;还有就是涉及到水下流体动力学的力量,和陆地空气的感觉是截然不同的。综合考虑上面说的这三个问题简单讲就是,人在水下会有这样的情况:因为浮力,脸部受到重力影响的向下幅度会减缓;手在脸边活动,水流压力会影响面部表情;向前行走,水还会给人一个向后的阻力。这些都是在陆地上实现不了的。

面对这些问题,Weta的解决方案是多方面进行组合,将流体模拟、肌肉模拟、头发模拟、布料模拟结合在一起,为角色和相应体积创建出一套复杂而又具有完整功能的方案。使这些元素交互在一起,不必每次只处理一个方面,而是以整体进行解决。从以往的制作经验来说,没有过在同一时间解决所有模拟的情况。一般情况下先模拟皮肤再模拟布料,接着头发和水的传统过程。但这种流程一旦出现问题,只能是一个环节一个环节返回去解决。而新的技术是获取演员在水下的动作,导入到角色的数字骨骼上,在同一时间搞定所有方面。

宣发统筹:聚城视界

案例推荐更多>>

文章推荐